AI en databeveiliging: een fijn evenwicht tussen bescherming en privacy

Nu kunstmatige intelligentie (AI) steeds vaker wordt ingezet binnen verschillende bedrijfsprocessen, wordt de samenkomst van AI en databeveiliging een steeds belangrijker onderwerp voor organisaties wereldwijd. Of het nu gaat om cloudgebaseerde copiloten of AI-tools van externe partijen, de kans op het per ongeluk blootstellen van gegevens is nog nooit zo groot geweest. Het is belangrijk om een goed evenwicht te vinden tussen vernieuwen en het veilig houden van data, en dat vraagt om zorgvuldige keuzes. In dit artikel belicht Frederik Stengaard, databeveiligingsexpert bij Fellowmind, de belangrijkste risico’s én best practices om AI op een veilige manier te integreren in de werkomgeving.

De risico's van het delen van te veel informatie

Frederik wijst op één van de grootste risico’s bij het gebruik van AI: het onbedoeld delen van te veel informatie.

“AI-tools, vooral copiloten, kunnen per ongeluk toegang krijgen tot persoonlijke of bedrijfsgevoelige gegevens als er geen goede beveiliging is,” legt Frederik uit. “Dat kan grote gevolgen hebben, zoals het overtreden van de AVG-regels of het prijsgeven van belangrijke bedrijfsgeheimen, bijvoorbeeld productiemethoden in de maakindustrie.”

Een eerste belangrijke stap is het vaststellen welke data echt belangrijk is voor de organisatie.

“We noemen deze gegevens de ‘kroonjuwelen’. Dat zijn de data en systemen die je het beste moet beschermen,” zegt Frederik.

Een voorbeeld hiervan zijn technische tekeningen die op een gedeelde schijf staan en worden gebruikt in een productielijn. Deze informatie is zeer gevoelig en AI-tools zouden hier geen toegang toe mogen hebben. Het herkennen en beschermen van dit soort belangrijke gegevens is een basis voor goede databeveiliging.

Omgaan met AI-tools van andere partijen

Het gebruik van AI-tools van externe partijen brengen extra risico’s met zich mee als het gaat om databeveiliging.

Frederik legt uit: “Als je bijvoorbeeld AI-tools gebruikt die afbeeldingen maken, zonder duidelijke afspraken over hoe data wordt verwerkt, kan dat leiden tot datalekken.”

Bij veel van deze tools is het niet duidelijk hoe ze met informatie omgaan. Daardoor kunnen organisaties het risico lopen dat gevoelige gegevens bij andere partijen terechtkomen zonder dat daar goede afspraken over zijn.

Om die reden kiezen steeds meer organisaties ervoor om het gebruik van externe AI-diensten te beperken of zelfs helemaal te verbieden.

Het invoeren van duidelijke regels over welke gegevens wel en niet kunnen worden gebruikt in AI-tools is essentieel om het risico op datalekken te verkleinen.

Zonder duidelijke beperkingen kunnen AI-tools ongemerkt gegevens verwerken en opslaan bij externe partijen, wat serieuze zorgen oproept over de veiligheid van bedrijfsdata.

Hoe je AI op een veilige manier gebruikt

Als AI wordt ingezet binnen bedrijfsprocessen, zijn er volgens Frederik een aantal goede werkwijzen die helpen om data veilig te houden:

- Opruimen en bijhouden: Zorg ervoor dat de rechten op bestanden en mappen up-to-date zijn, en verwijder oude deel-links die nog openbaar staan. Zo verklein je de kans dat gevoelige gegevens per ongeluk toegankelijk zijn.

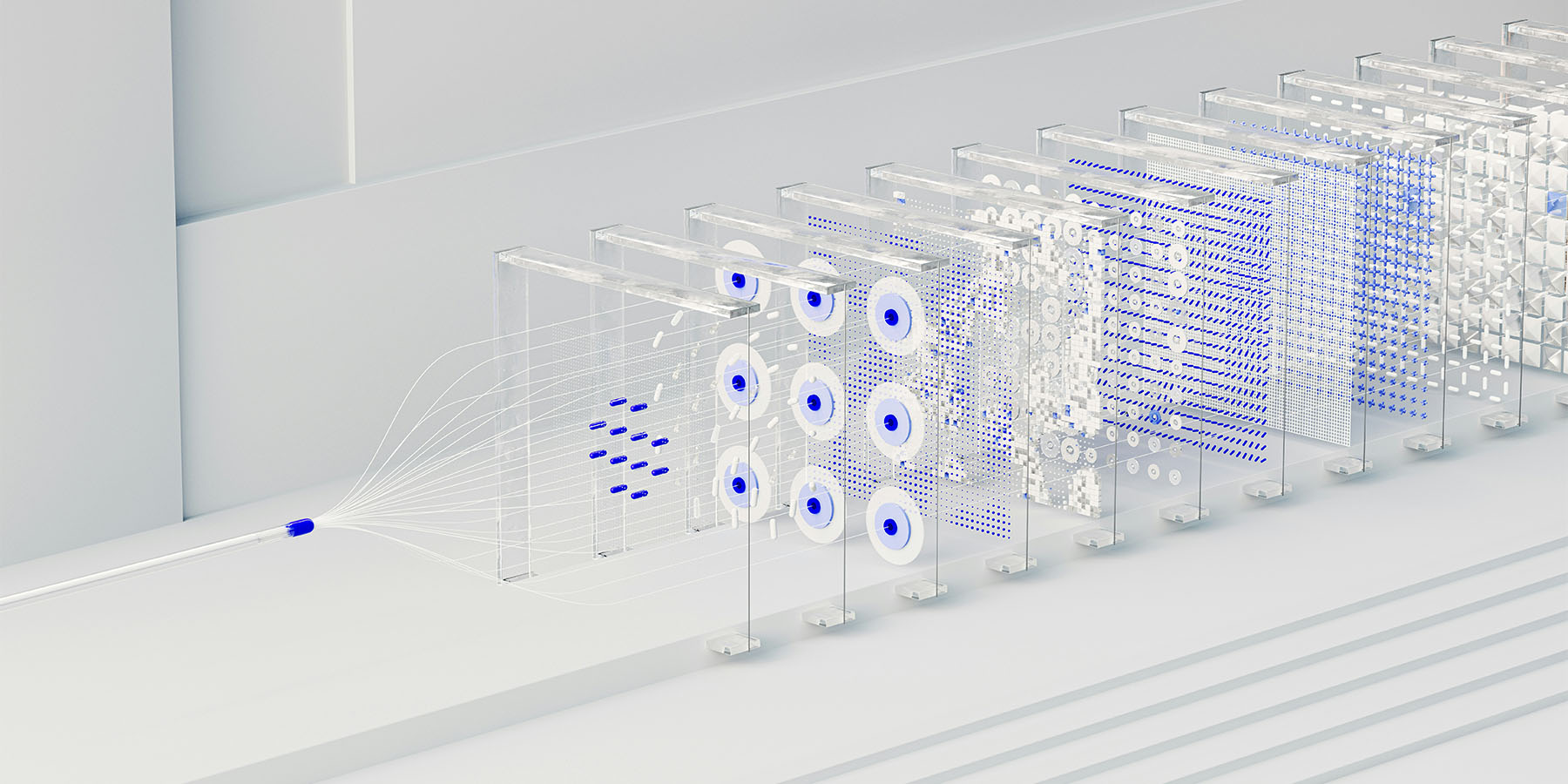

- Bepalen welke gegevens beschermd moeten worden: Door data in te delen in categorieën zoals openbaar, intern en vertrouwelijk, kun je voor elk type data passende beveiliging instellen. Dit helpt teams om te begrijpen welke informatie extra bescherming nodig heeft.

- Gebruik van beschermende maatregelen: Met hulpmiddelen zoals DLP (Data Loss Prevention) kun je voorkomen dat gevoelige informatie gedeeld wordt met AI-tools, of dat gebruikers kritieke vragen stellen aan een AI die deze data verwerkt. “Dit soort hulpmiddelen zijn belangrijk om te voorkomen dat medewerkers onbewust de regels voor databeveiliging overtreden,” zegt Frederik.

- Werk samen met een betrouwbare partner zoals Fellowmind: Fellowmind heeft jarenlange ervaring in databeveiliging en biedt oplossingen op maat. We helpen organisaties om duidelijke regels op te stellen en systemen in te richten die datalekken voorkomen en risico’s tijdig signaleren. Zo kun je veilig innoveren, zonder dat je data in gevaar komt.

Tot slot: geef prioriteit aan databeveiliging in het AI-tijdperk

Nu AI-tools steeds vaker gebruikt worden op de werkvloer, is het belangrijker dan ooit om databeveiliging prioriteit te geven. Gevoelige informatie beschermen vraagt om een aanpak in meerdere lagen. Dat begint bij het beperken van toegang tot kritieke data en het instellen van slimme beveiligingsmaatregelen.

Door goede werkwijzen te volgen, zoals het opruimen van verouderde omgevingen, het indelen van data in categorieën en het beperken van AI-tools van externe partijen, kunnen organisaties AI veilig inzetten zonder onnodige risico’s te lopen.

Zoals Frederik het mooi samenvat:

“AI biedt enorme kansen voor vernieuwing, maar moet met zorg worden ingezet. Het herkennen en beschermen van belangrijke data is de eerste stap om te zorgen dat AI voordeel oplevert zonder dat je veiligheid of privacy inlevert.”